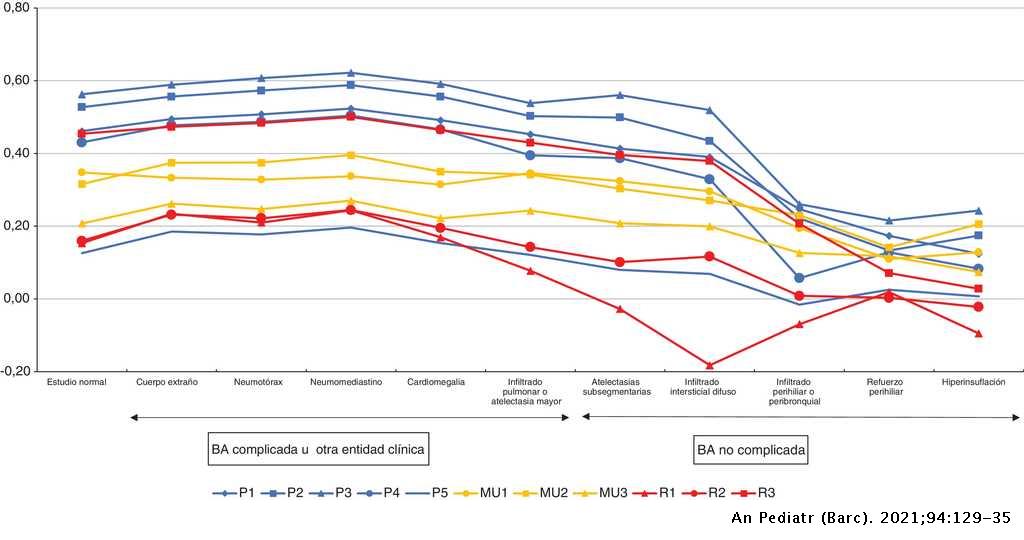

La radiografía de tórax en la bronquiolitis aguda: calidad técnica, hallazgos y evaluación de su fiabilidad | Anales de Pediatría

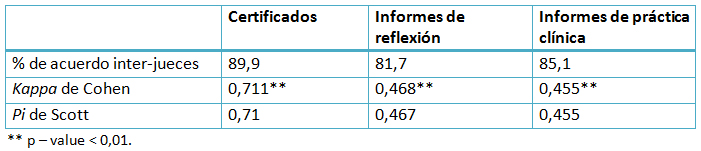

Fiabilidad inter-jueces en evaluaciones portafolio de competencias profesionales en salud: el modelo de la Agencia de Calidad Sanitaria de Andalucía - Medwave

Redalyc.CÁLCULO DE LA FIABILIDAD Y CONCORDANCIA ENTRE CODIFICADORES DE UN SISTEMA DE CATEGORÍAS PARA EL ESTUDIO DEL FORO ONLIN

Experiencia exploratoria de validación de un instrumento sobre nivel de cultura financiera en la generación millennial

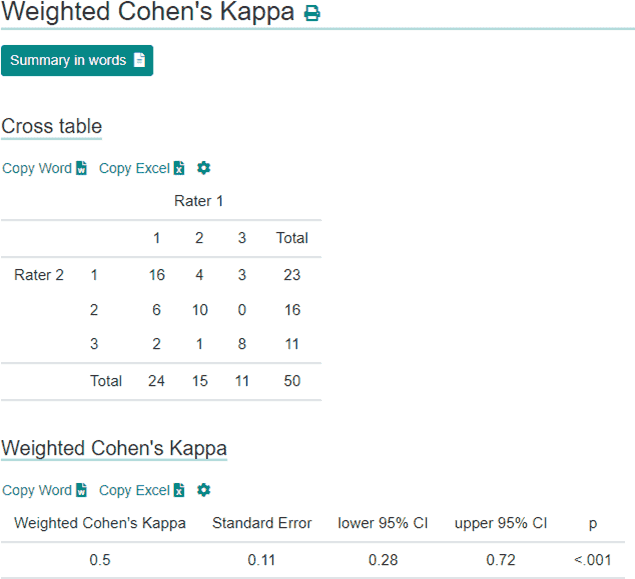

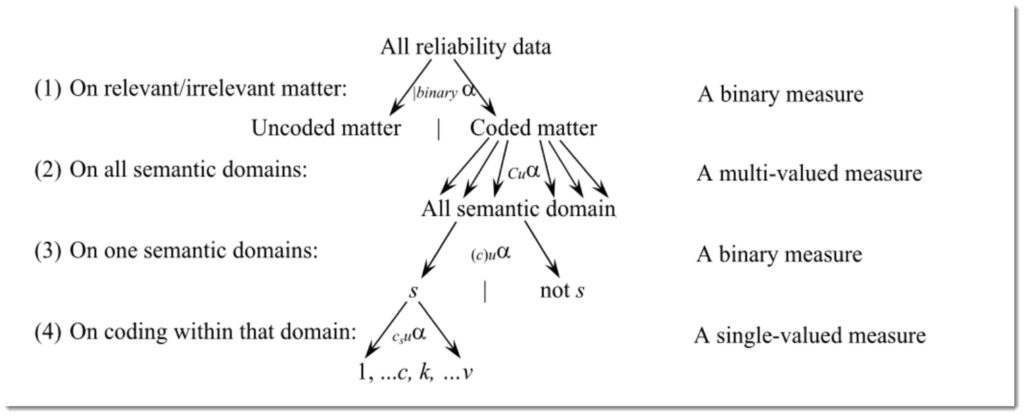

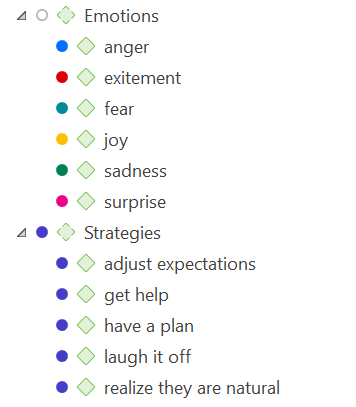

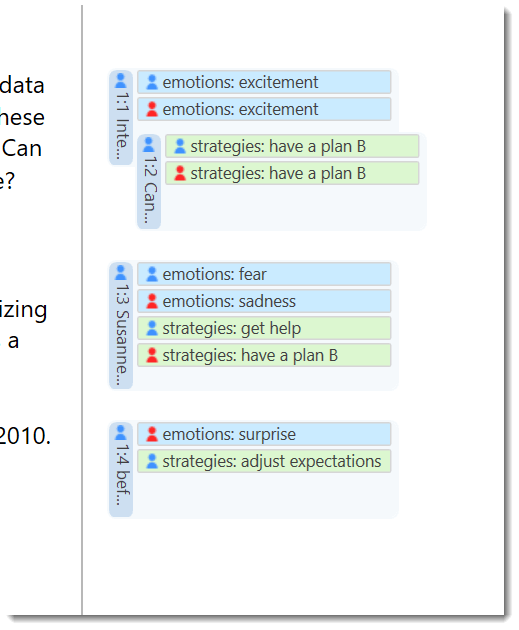

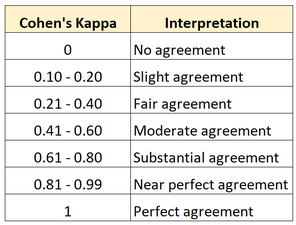

Medición del Acuerdo entre Codificadores: Por qué el Kappa de Cohen no es una buena opción - ATLAS.ti | El software nº 1 para el análisis cualitativo de datos

Medición del Acuerdo entre Codificadores: Por qué el Kappa de Cohen no es una buena opción - ATLAS.ti | El software nº 1 para el análisis cualitativo de datos

Alda (Aldanálisis) on Twitter: "Índice o Coeficiente kappa (kappa de Cohen). #Estadísticas #Fiabilidad Ver: https://t.co/ofbK3qRlQX https://t.co/nT6UCKJTlc" / Twitter

![PDF) [Paquete estadístico SPSS] La Kappa de Cohen | Jacob Sierra-Díaz - Academia.edu PDF) [Paquete estadístico SPSS] La Kappa de Cohen | Jacob Sierra-Díaz - Academia.edu](https://0.academia-photos.com/attachment_thumbnails/67270580/mini_magick20210509-11451-pavg87.png?1620574655)